episode 01 / 40:18

Pilotfolge: Content-Ideation, Payload-CLI & Vercel Labs

Pilotfolge. Jens und Christoph zeigen einander, woran sie gerade arbeiten. Vier Themen: AI-Content-Ideation mit dem Content Fuel Framework, eine token-sparsame Payload Content CLI für AI-Agents, Infografiken über HTML statt Bildgenerator und drei Tools aus den Vercel AI Labs.

mit Jens Becker & Christoph Paterok

Wie aus losen Calls ein Podcast wurde

Jens und Christoph treffen sich seit langem in unregelmäßigen Abständen und zeigen sich gegenseitig, woran sie gerade arbeiten. Aus diesen Calls ist dann die Idee entstanden, dabei den Aufnahme-Knopf zu drücken: Vielleicht interessiert es ja noch jemanden.

Jens ist selbstständiger Softwareentwickler mit Fokus auf Web-Apps, CMS-Projekte und AI-Integration für Firmen im DACH-Raum, die letzten Jahre intensiv mit Payload CMS. Christoph baut seit fast 20 Jahren Webseiten, eigene Projekte, SEO und ist als freier Product Owner unterwegs. Beide nutzen täglich AI in echten Projekten — und genau darüber soll der Podcast sein. Hands-on, aus der Praxis, alle zwei Wochen, im Zwei-Host-Dialog.

AI-Content-Ideation mit dem Content Fuel Framework

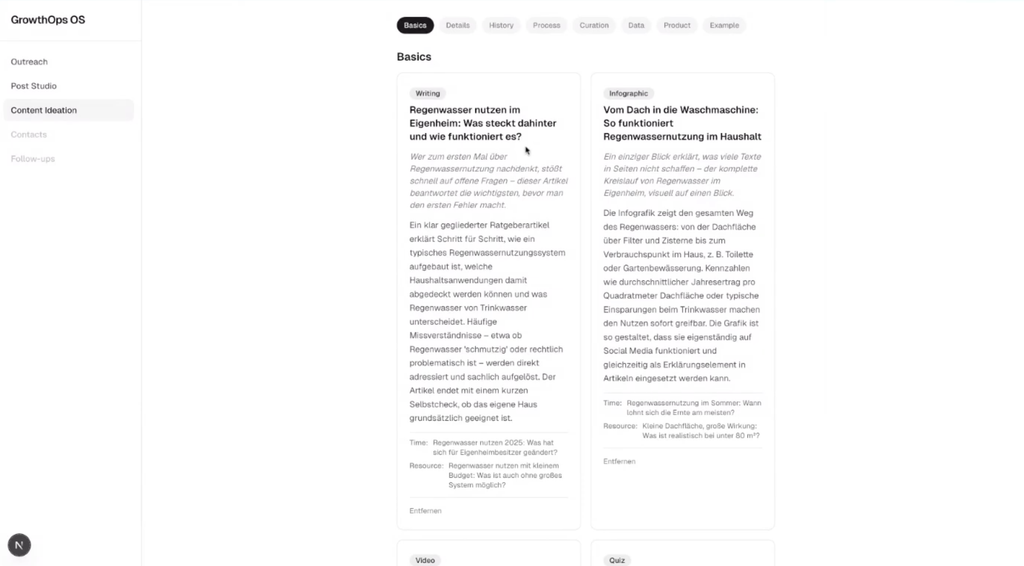

Christoph zeigt sein Tool zur AI-gestützten Content-Ideation. Grundlage ist das Content Fuel Framework von Melanie Deziel — eine Matrix aus Fokus-Themen (Menschen, Grundlagen, Details, Prozesse, Kuration etc.) und Formaten (Text, Infografik, Audio, Video, Live-Video, Quiz, Map …). Jede Zelle der Matrix ist ein potenzieller Content-Anker, auf den man manuell oft nicht kommt.

Sein selbstgebautes „GrowthOps OS" nimmt Thema, Zielgruppe, Sprache, Marke und Tonalität entgegen und triggert einen n8n-Workflow. Der Workflow loopt über jedes Fokus-Thema, prompted für jede sinnvolle Format-Kombination und schreibt die Ideen in eine n8n Data Table. Weil das Ganze rund 10 Minuten dauert, nutzt die Web-App ein Polling-Pattern statt einen blockierenden Request — die App fragt im Intervall „bist du fertig?", bis das Ergebnis steht.

Im Beispiel-Lauf zum Thema „Regenwassernutzung im Haushalt" liefert das Tool ein gefülltes Backlog mit deutlich nischigeren Ideen, als manuell entstehen — von „Regenwasser im Eigenheim, wie funktioniert's?" bis „vom Dach in die Waschmaschine" als Infografik. Nicht jede Idee taugt, deswegen gibt es einen Entfernen-Button. Aber die Trefferquote für brauchbare Ideen ist hoch genug, um das Tool produktiv einzusetzen — vor allem in Themen-Bereichen, in denen man nicht ohnehin schon tief drinsteckt.

Payload Content CLI: AI-Schnittstelle ans CMS

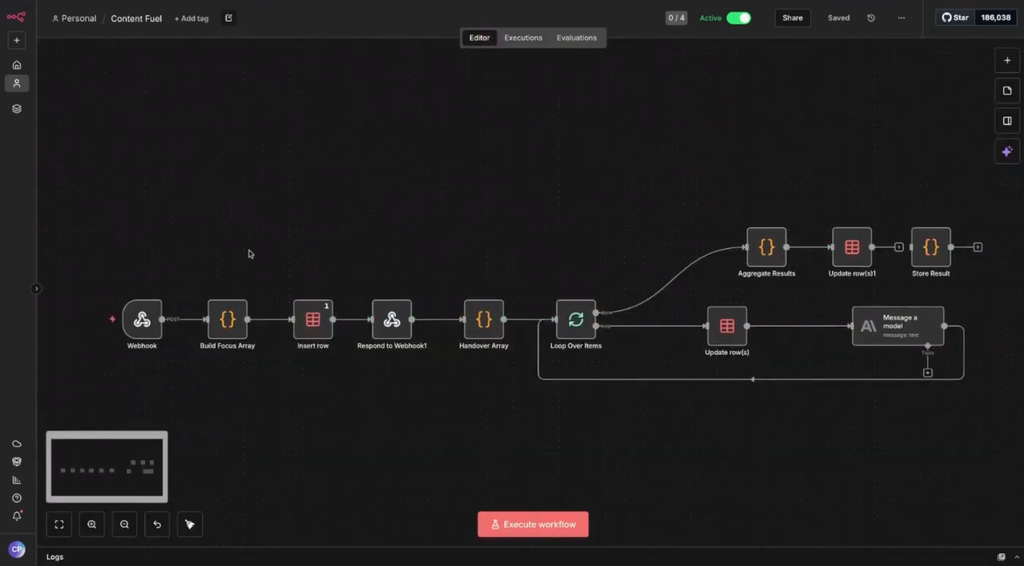

Jens stellt sein aktuelles Open-Source-Projekt vor: eine CLI, die AI-Agents einen deutlich effizienteren Zugang zu Payload CMS gibt als das bestehende MCP-Plugin. Hintergrund: bei größeren Projekten mit viel Content kommt das MCP-Plugin schnell an seine Grenzen — der Agent zieht ständig große JSON-Blöcke ins Kontext-Fenster, muss bei kleinen Änderungen den ganzen Block neu generieren, und es gibt regelmäßig Probleme mit Encoding und Anführungszeichen.

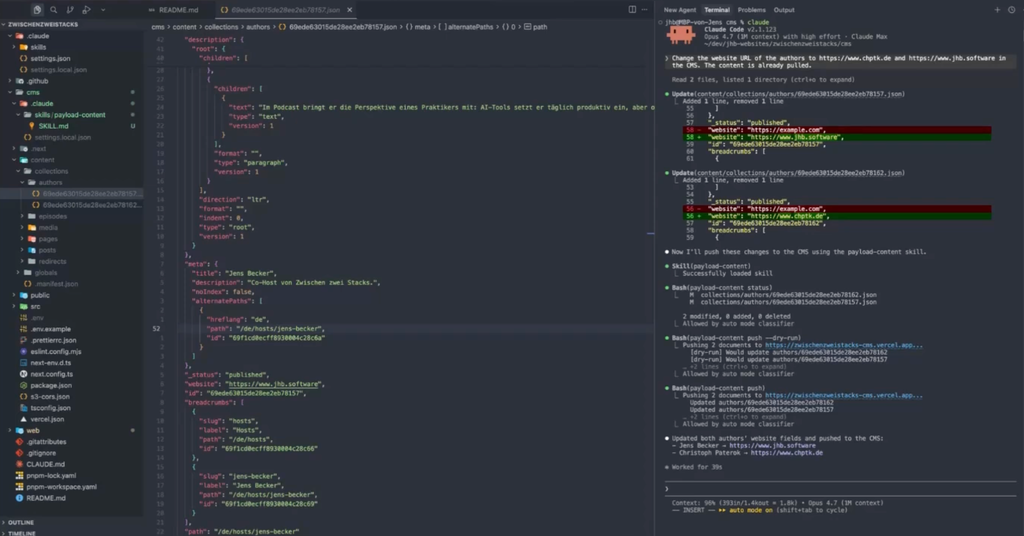

Die CLI bringt zwei Kernideen mit: erstens den vollständigen REST-API-Funktionsumfang von Payload als CLI-Kommandos (`me`, `find`, `create`, `update`, …) und zweitens ein `pull`-Kommando, das das komplette CMS — jede Collection, jedes einzelne Document — als JSON-Dateien lokal auf die Festplatte zieht. Der Agent arbeitet danach mit den Standard-Tools (Edit, Update) auf den lokalen Dateien und pusht die Änderungen am Ende zurück.

Live-Demo mit Claude Code: ein Prompt fordert eine Aktualisierung der beiden Autoren-Seiten an. Claude lädt das mitgelieferte Skill-Snippet, ruft `pull`, editiert die zwei JSON-Dateien direkt, prüft den Status und pusht. Im CMS ist die Änderung sofort sichtbar.

Der Token-Verbrauch ist im Vergleich zum MCP-Plugin „in einer ganz anderen Welt" — und das ist nicht nur eine Kosten-, sondern auch eine Energie-Frage. Inhaltlich passt der Ansatz zur Diskussion der letzten Monate, ob man für AI-Agents überhaupt noch ein CMS braucht oder besser direkt mit Markdown-Files arbeitet. Die CLI ist der Mittelweg: CMS bleibt für die Business-Seite, der Agent arbeitet aber auf strukturierten lokalen Files.

Die CLI funktioniert ohne Konfiguration im Payload-Projekt. Optional gibt es ein Plugin, das das Schema in die CLI exposet, damit der Agent typed arbeiten und mehr Schema-Infos nutzen kann. Veröffentlichung als Open-Source-Paket auf NPM steht kurz bevor.

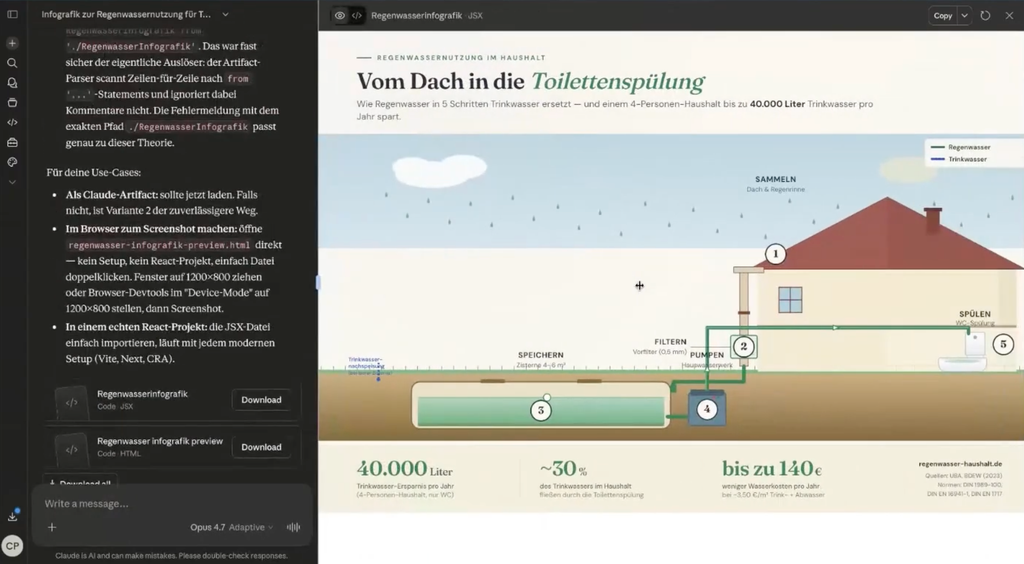

Infografiken mit AI: HTML statt Bildgenerator

Christophs zweites Thema: Infografiken mit AI generieren — aber eben nicht über einen Bildgenerator, sondern über HTML. Sein Trick ist simpel: der Agent (in seinem Fall Claude) soll keine PNG-Datei rendern, sondern eine HTML- bzw. JSX-Datei mit der Grafik bauen. Davon macht er dann einen Screenshot.

Der Vorteil ist mehrfach. Die Texte stimmen meist auf Anhieb und sind editierbar, weil sie nicht durch ein Bild-LLM laufen. Anpassungen an Layout oder Wortlaut sind trivial — wer ein bisschen HTML/CSS kann, ändert die Datei direkt. Und wenn man die Grafik nicht als Bild, sondern als Inline-HTML auf der Webseite einbindet, wird sie automatisch SEO-freundlich, barrierefrei und kann sogar interaktiv werden — z.B. animierte Regentropfen, die den Wasserfluss zeigen.

Jens ergänzt: für sehr kleine Use Cases reicht oft auch eine reine SVG-Ausgabe vom Agent — dann spart man sich sogar den Screenshot-Schritt. Für größere Grafiken bleibt der HTML-Weg sinnvoller.

Vercel AI Labs: Agent Browser, Portless, AI SDK

Jens letztes Thema: drei Tools aus den Vercel AI Labs, die er täglich nutzt. Vercel hat öffentlich angekündigt, in diese Open-Source-Reihe deutlich mehr Ressourcen zu stecken — Tools rund um effizientes Arbeiten mit AI-Agents, und nicht alle Vercel-spezifisch.

Agent Browser ist eine global installierbare CLI, die einem Agent einen Browser zur Verfügung stellt — ohne eigenes Puppeteer- oder Playwright-Setup. Der Agent öffnet Webseiten, macht Screenshots oder zieht einen Accessibility-Tree-Snapshot (deutlich Token-sparender als ein vollständiger Screenshot). Praktisch, wenn ein Coding-Agent seine eigene Arbeit am Frontend verifizieren soll. Im Hintergrund lief eine Zeit lang Playwright, mittlerweile gibt es eine eigene Implementierung.

Portless löst ein Problem, das mit parallelen Agent-Sessions immer häufiger auftritt: zwei Agents starten Dev-Server, kommen sich auf demselben Port in die Quere oder man verliert den Überblick, welcher Port zu welchem Projekt gehört. Portless mappt jedes Projekt über eine `.localhost`-TLD auf eine stabile, sprechende URL — keine Port-Konflikte, klare Zuordnung. Per Default lokal, optional ins Netzwerk exposed.

Die Vercel AI SDK ist die provider-agnostische SDK-Schicht: heute Claude, morgen GPT, übermorgen ein anderes Modell — ohne Code-Umbau. Christoph fasst zusammen: ein Hub bzw. Gateway, der das Routing übernimmt und außerdem als Lernhilfe taugt, weil die Begrifflichkeiten der einzelnen Provider auf der Meta-Ebene deutlicher werden.

Jens betont: gerade beim Bau eigener Agents — z.B. seines Chat-Agent-Plugins für Payload — lohnt es sich, sich mit Tools, Tokens, Kosten und den Stärken und Schwächen der Modelle bewusst auseinanderzusetzen. Wer einfach eine Subscription bucht und Tokens durchballert, verliert das Gefühl dafür, was unter der Haube passiert. Provider-agnostische SDKs helfen, dieses Verständnis wieder aufzubauen.

Wrap-up

Format-Commitment: alle zwei Wochen, im Zwei-Host-Dialog. Themenwünsche und ehrliches Feedback sind willkommen.

.jpeg)